얼마전에 메타AI에서 론칭한 <메타데모랩> 사이트를 알게 되었습니다.

이 사이트에서는 아이들이 그린 그림을 애니메이션으로 만들어주고 있었습니다.

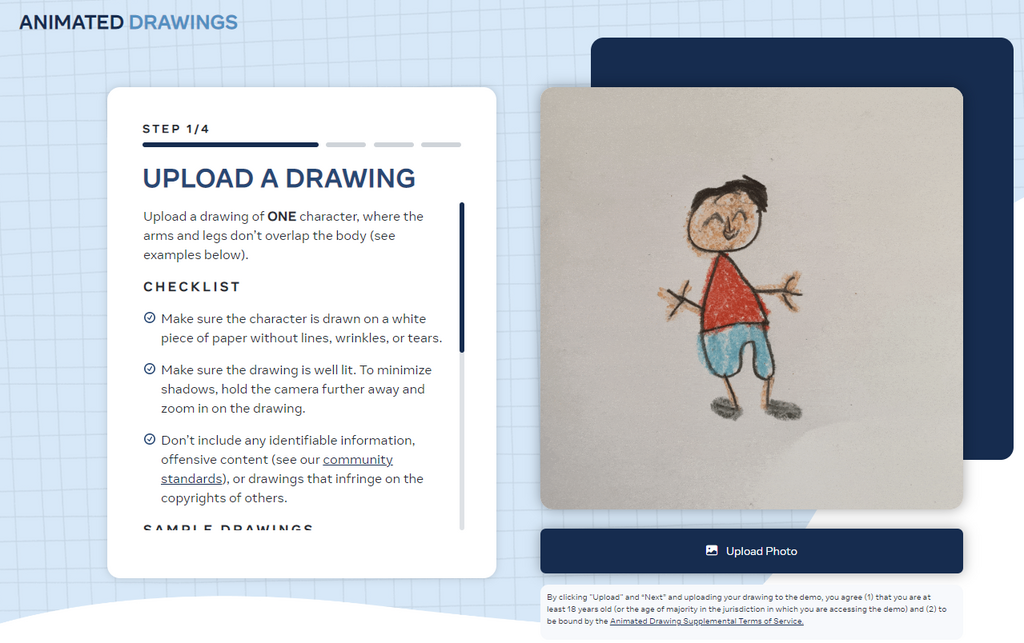

[START] 버튼을 눌러 아이들이 그린 그림을 업로드하게 되면,

자동적으로 신체부위를 인식하고 이를 기반으로 춤을 추기, 걷기, 뛰기, 다양한 움직임 등을

연출할 수 있었는데요.

이 프로젝트는 메타가 오픈소스 기반으로 만든 데모 버전의 아웃풋이지만,

개인적으로 이러한 프로젝트가 고도화될 것이라는 건 분명하다고 봐요.

그래서 직접 들어가서 테스트를 해봤습니다.

일단 가지고 있는 고양이 사진을 업로드를 해봤는데요.

그림이 아닌 사진이라 그런지 신체부위 인식을 잘 해내지 못하더라고요.

여기에 포토 업로드라 하지만, 실제 사진이 아닌 그린 그림을 추천합니다.

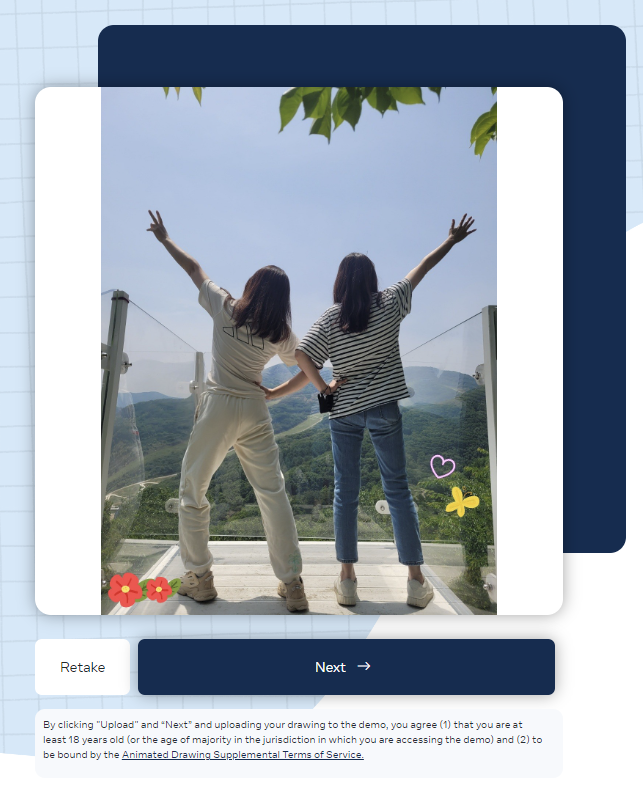

제가 혹시나 해서 보유하고 있는 사진 한장을 업로드해봤습니다.

다음과 같이 사진 업로드를 하면 [NEXT] 버튼이 생기게 되고,

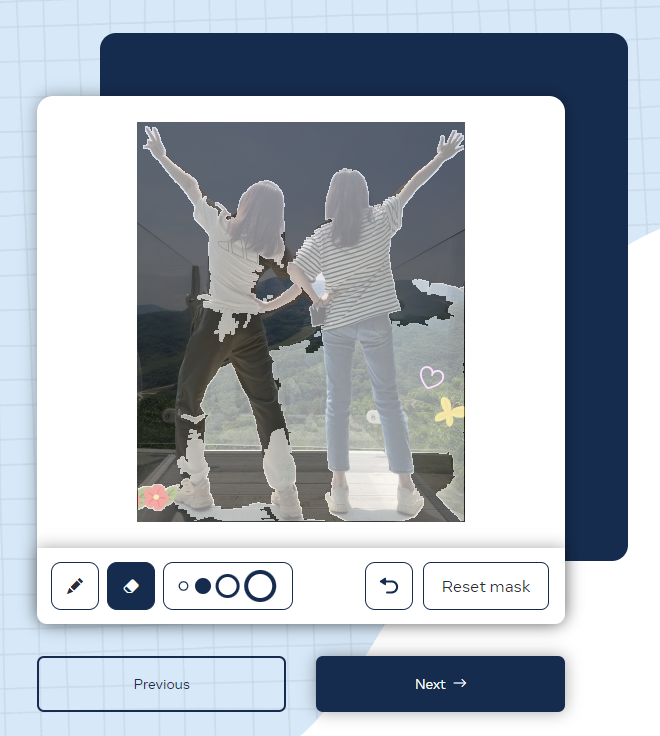

AI가 한번 스캔을 하면서 주요 신체부위를 체크하게 되고요.

특별한 사항이 없으면 바로 만들기를 누르게 됩니다.

분명 신체부위를 인식하기는 했지만, 사진이라 그런지 영상 미리보기를 할 때

정신없는 장면이 튀어 나옵니다

그리고 이렇게 자유분방하게 움직이게 되죠.

저는 이게 정신이 없어서 캡쳐만 했습니다.

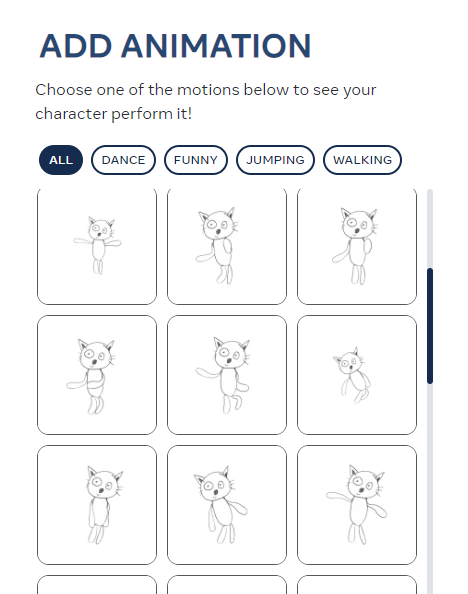

실제 이 영상이 프리뷰로 뜨게 되면 좌측에

다양한 동작으로 영상콘텐츠를 만들 수 있도록 가이드 영상을 보여주는데요

이 가이드 중에 하나를 선택하면 인사도 하고 걷기도 하고 춤도 춥니다.

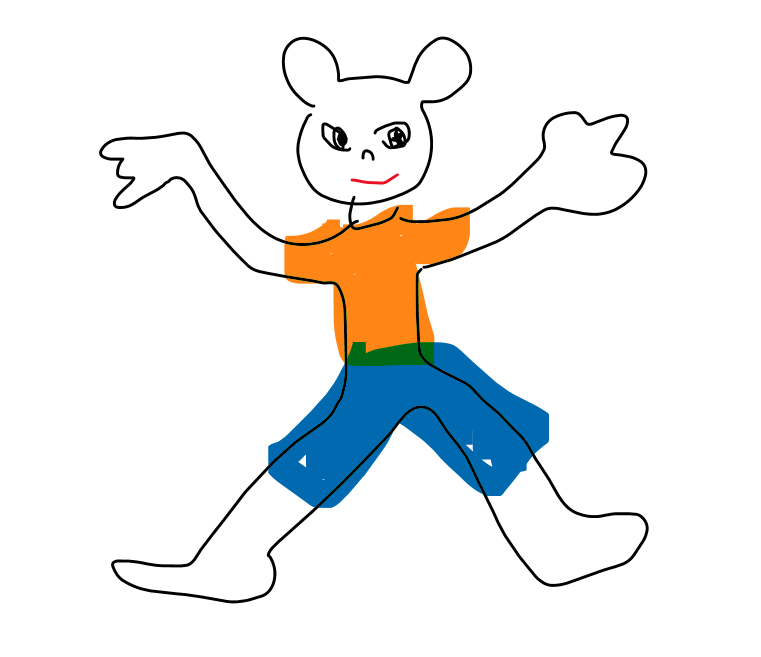

그래서 이번에는 제대로 해보려고,

노트북을 이용해서 대충 그림을 그려봤습니다.

이렇게 그린 그림을 메타데모랩에 업로드를 했죠.

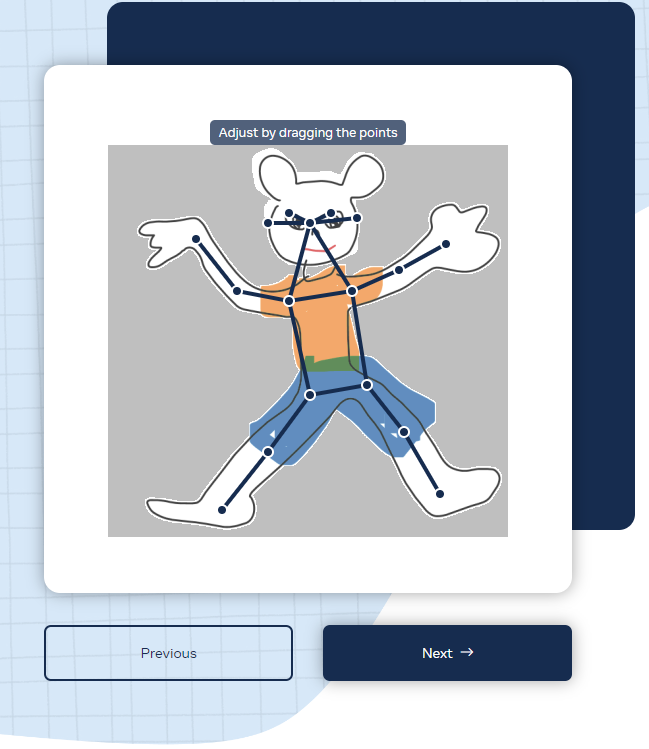

그리고 [NEXT] 버튼을 눌렀더니 다시 스캔을 하면서 신체부위를 잡아냅니다

바로 이렇게 말이죠.

가끔 신체부위를 잡아내는데 얼굴을 못 잡아내는 경우가 있더라고요

그럴 때는 미세하게 조정하는 편집 기능이 있어서

해당 부위에 커서를 갖다대면 금방 인식을 합니다.

그렇게 만들어진 영상은 다음과 같아요.

(영상 링크 : https://brunch.co.kr/@vivitheone/188 ) <-- 콘텐츠에 영상 업로드가 지원되지 않아서, 영상을 보시려면 위 브런치 글 클릭 바랍니다~

첫번째 영상은 셔플댄스를 추고 있는 고양이입니다.

그리고 앞서 여러 가이드 동작이 있다고 했는데요.

해당 가이드 동작 중에 이번에 웨이브를 클릭했더니, 다음의 영상이 완성되었습니다.

(영상링크: https://brunch.co.kr/@vivitheone/188 )

이렇게 그림을 직접 그려 만들어보니,

아이들의 그림을 이렇게 애니메이션화 하면 정말 재미있어할 것 같다는 생각이 들었습니다.

현재 오픈 소스 방식으로 이루어지는 데모 프로젝트이지만,

저는 이 방식이 그림에서 머무르지는 않을 것 같아요.

마케팅 측면에서 본다면,

결국 한장의 사진으로 다양한 동작을 연출해낼 수 있다면,

더불어 동작을 추가로 생성할 수 있다면,

사진에 생명을 불어넣게 되고, 이는 광고적인 측면에서도 새로운 도구로서 사용될 것 같습니다.

더불어, 요즘같이 동영상 제작, 편집이 많은 인기를 얻는 시기에

AI로 간단하게 만드는 영상 편집 기능이 고도화되면 될수록,

사람들이 콘텐츠를 만드는 방식이 이미지 -> 영상으로 더 빠르게 바뀌지 않을까 생각이 듭니다.

======================

* 직접 테스트해볼 경우 아래의 링크를 클릭하세요! (메타데모랩)